Een studie gepubliceerd in Nature Health toont aan dat de manier waarop AI in de workflow van de radioloog wordt geïntegreerd, een aanzienlijke invloed heeft op de perceptie van aansprakelijkheid bij diagnostische fouten.

De integratie van AI in de radiologie vordert snel: binnen dit specialisme is het aantal door de FDA goedgekeurde AI-toepassingen het hoogst van alle vakgebieden. Maar één vraag blijft grotendeels onbeantwoord – en is toch cruciaal voor de dagelijkse praktijk: wanneer AI een afwijking signaleert die de radioloog over het hoofd ziet, wie draagt dan de juridische verantwoordelijkheid voor de fout? Een studie die op 10 maart 2026 in Nature Health is gepubliceerd door onderzoekers van het Penn State College of Medicine, Brown University en de Seton Hall University School of Law, geeft empirische antwoorden op deze vraag, met directe implicaties voor de werkorganisatie in de medische beeldvorming.

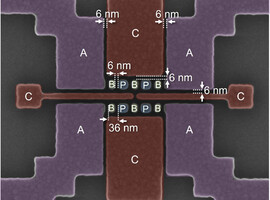

De onderzoekers legden aan 282 deelnemers, die de rol van juryleden speelden, een fictief scenario van medische nalatigheid voor. Een patiënt lijdt aan onomkeerbare hersenletsels omdat een radioloog een intracraniële bloeding niet heeft opgemerkt op een hersenscan, terwijl het AI-systeem de scan correct als abnormaal had geïdentificeerd. De deelnemers werden willekeurig verdeeld over twee groepen die overeenkwamen met twee verschillende workflows. In de eerste (enkele lezing) raadpleegde de radioloog de resultaten van de AI en interpreteerde hij de scan vervolgens één keer. In de tweede (dubbele lezing) voerde de radioloog een eerste interpretatie uit voordat hij de feedback van de AI ontving, en las hij de scan vervolgens een tweede keer door nadat hij kennis had genomen van de waarschuwing. In beide gevallen was de conclusie van de radioloog identiek: geen bloeding.

In het scenario met één lezing was bijna 75% van de juryleden van mening dat de radioloog zijn zorgvuldigheidsplicht niet had nageleefd. Dit percentage daalde tot 53% in het scenario met dubbele lezing (p = 0,0002; odds ratio 2,6; 95% BI [1,6–4,3]). Met andere woorden, de juryleden waren bijna 50% meer geneigd de eiser gelijk te geven wanneer de radioloog het onderzoek slechts één keer had bekeken na de waarschuwing van de AI. De resultaten benadrukken dat er nu meerdere vooroordelen zijn die radiologen ertoe aanzetten de AI niet tegen te spreken, omdat de kosten van het oneens zijn met de AI en ongelijk hebben op medisch-juridisch vlak te hoog zijn.

Bovendien herinnert deze studie aan het belang van een transparante communicatie over de prestaties van de AI (percentage vals-positieve en vals-negatieve resultaten), zowel aan clinici als aan patiënten. De kwestie van de juridische aansprakelijkheid in verband met AI in de geneeskunde is niet langer theoretisch: ze bepaalt nu al de perceptie van het publiek en, mogelijk, gerechtelijke beslissingen.