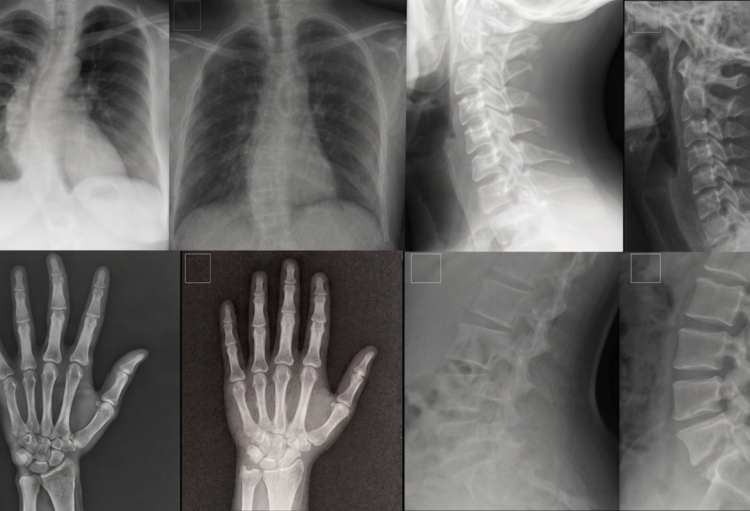

Des radiographies générées par intelligence artificielle sont désormais suffisamment réalistes pour échapper à la vigilance de radiologues expérimentés. Une étude publiée dans Radiology montre que des clichés synthétiques produits avec GPT-4o ont été interprétés correctement sur le plan diagnostique dans 92,4% des cas, soit un taux comparable à celui des radiographies authentiques. Même avertis de la présence de deepfakes, les radiologues participants n’ont identifié correctement les faux que dans 75% des cas. Numerikare vous propose de tester à votre tour si vous pouvez distinguer le vrai du faux.

L’étude de Yair Tordjman, Mehmet Yuce et leurs collègues a impliqué 17 radiologues de six pays. Les chercheurs ont soumis aux participants un mélange de 77 radiographies authentiques et 77 images générées par GPT-4o, sans leur préciser que certaines étaient artificielles.

Dans cette première phase, 59% des radiologues n’ont rien remarqué d’inhabituel. Les performances diagnostiques se sont révélées comparables entre les deux groupes d’images : 92,4% de précision diagnostique pour les radiographies synthétiques contre 91,3% pour les clichés authentiques, sans différence statistiquement significative.

Dans un second temps, les radiologues ont été informés de la présence d’images générées par IA et invités à distinguer les faux clichés des vrais. Leur taux global de détection a atteint 75%, ce qui signifie qu’une image synthétique sur quatre n’a pas été identifiée comme telle malgré une recherche active des deepfakes.

Les auteurs n’ont observé aucune corrélation entre l’expérience professionnelle et les capacités de détection (P = 0,45). Selon l’étude, les radiologues les plus expérimentés n’ont pas obtenu de meilleurs résultats que les plus jeunes praticiens.

Treize des 17 radiologues participants, soit 76%, ignoraient par ailleurs avant l’étude que ChatGPT pouvait générer des radiographies réalistes.

Les chercheurs ont également évalué plusieurs modèles multimodaux d’intelligence artificielle. GPT-4o a identifié correctement 85% des images qu’il avait lui-même générées, tandis que GPT-5 atteignait 83%. Les performances de Gemini 2.5 Pro et de Llama 4 Maverick sont restées proches du hasard, avec respectivement 56% et 59% de précision.

Les auteurs soulignent que cette étude marque une rupture par rapport aux précédents travaux sur les deepfakes médicaux. Jusqu’ici, la génération d’images médicales synthétiques reposait principalement sur des réseaux antagonistes génératifs (GAN), nécessitant des compétences techniques avancées et des bases d’entraînement spécialisées. Avec les grands modèles multimodaux accessibles au grand public, une simple requête textuelle suffit désormais à produire une radiographie thoracique jugée plausible sur le plan diagnostique.

L’étude évoque plusieurs risques potentiels : fraude à l’assurance avec imagerie fabriquée, falsification de preuves médicales dans des litiges, intégration d’images synthétiques dans des bases de données publiques utilisées pour entraîner des IA médicales, ou encore création volontaire de pathologies fictives.

Les auteurs pointent également plusieurs lacunes actuelles, notamment l’absence de mécanismes de signalement des images médicales synthétiques, l’absence de métadonnées DICOM standardisées permettant de tracer l’origine des clichés, ainsi que le manque de recommandations réglementaires explicites de la U.S. Food and Drug Administration ou de la European Medicines Agency.

Ils recommandent aux services de radiologie de mettre rapidement en place des formations de sensibilisation aux deepfakes, des systèmes de vérification de provenance des images DICOM et des procédures institutionnelles d’authentification des examens externes intégrés dans les PACS.

Et vous, sauriez-vous reconnaître une vraie radiographie d’une image générée par IA ?

> Testez -vous en cliquant ici

Lire aussi :

> Erreurs diagnostiques en radiologie : GPT-4 montre ses capacités

> L'IA soulage-t-elle vraiment les radiologues ?

> IA et responsabilité médicale en radiologie : le workflow change la donne juridique

> Piratages informatique d'un service de radiologie pour modifier les résultats de l'imagerie médicale